Такого вы не увидите в интернетах!

Помимо четырёх залов с трансляциями, у нас открыты две аудитории для митапов и круглых столов с приглашёнными экспертами. Если вы на площадке — обязательно заходите!

Для всех, кто в онлайне: ловите прямую трансляцию с дискуссии VK Mini Apps «Открытые платформы: кому они нужны и как бустят отрасль» у @milanrodd: vk.cc/6MWNUR. Начало ровно в 16:50 ?

Другие записи сообщества

Ежегодный день донора: как это было ?

В начале марта мы провели день донора. В этот раз в московском и питерском офисах VK ими стали 112 человек — всего удалось сдать более 50 литров крови, а 10 добровольцев вступили в регистр доноров костного мозга.

По доброй традиции любой сотрудник мог оставить деньги на благотворительность — в этот раз все средства мы перевели пушистым подопечным фонда «Рука помощи бездомным животным».

Делаем добро вместе ❤

#team@vkteam

Go-go-go, разработчики!

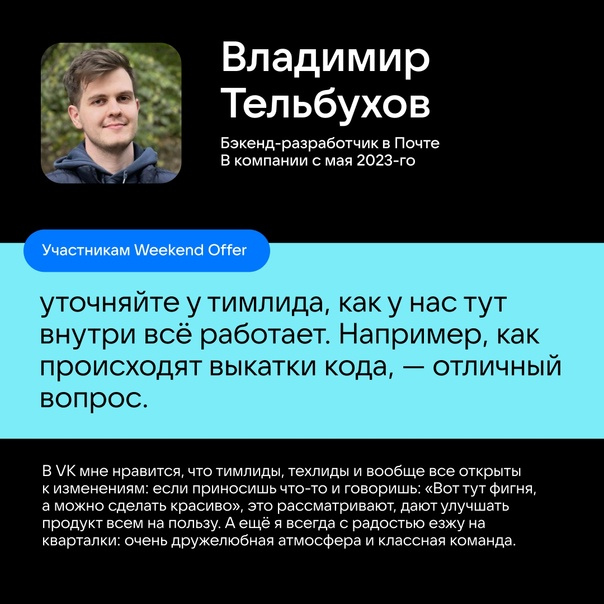

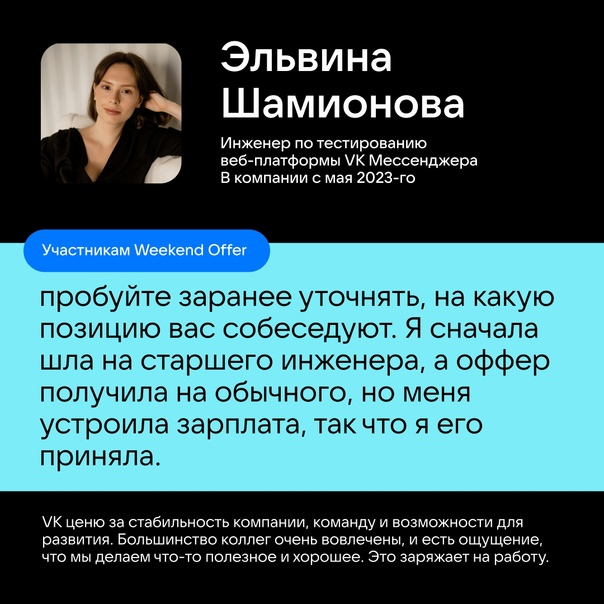

В эти выходные есть отличный шанс стать частью команды VK c Weekend Offer! Нам нужны специалисты разного уровня — смотрите вакансии и регистрируйтесь до полудня 15 марта: vk.cc/cvqlnl.

С прошлых Weekend Offer у нас работают десятки сотрудников. Знакомьтесь, вот некоторые из них.

#jobs@vkteam #Почта@vkteam

Одна ML-модель — и много учителей ?

На VK JT анонсировали решение на базе вертикального федеративного обучения, которое позволит компаниям совместно обучать ИИ-модели без обмена данными.

Что это значит? В первую очередь — куда более эффективное обучение любой ML-модели, которая будет получать данные сразу из нескольких источников, заинтересованных в её эффективности. Это могут быть самые разные данные с разных серверов, но ML-модель получит промежуточные зашифрованные вычисления, так что исходники останутся приватными.

Такие новости — от руководителя группы Data Science в VK Predict Артёма Агафонова. Совсем скоро поделимся записью трансляции — можно будет узнать подробности.

#it@vkteam #VKPredict@vkteam

VK Mini Apps + RuStore = ?

Сервисы VK Mini Apps теперь доступны в RuStore: разработчики мини-приложений получили дополнительную точку входа в сервисы и возможность привлечь новую аудиторию.

Инструменты платформы VK Mini Apps позволяют легко создавать и тестировать кросс-платформенные сервисы, гипотезы и проекты, быстрее проходить путь от идеи до пользователя. Мини-приложения из RuStore не нужно скачивать: они обновляются без загрузки и установки дополнительного программного обеспечения.

Если вы разработали сервис и хотите, чтобы он появился в магазине, подайте заявку — в панели администрирования приложений выберите пункт «Модерация». Только убедитесь, что ваш проект соответствует правилам размещения в RuStore: vk.cc/cv4L2g.

Удачи ?

1 000 компаний — с технологиями RuStore ?

На VK JT директор по продукту RuStore Олег Афанасьев рассказал, что для разработчиков и издателей приложений созданы все необходимые и эффективные инструменты для размещения и их уже используют такие компании, как Сбер, Тинькофф и Ozon.

Подключайтесь к трансляции на сайте vkjt.ru, нас ждёт ещё много интересного!

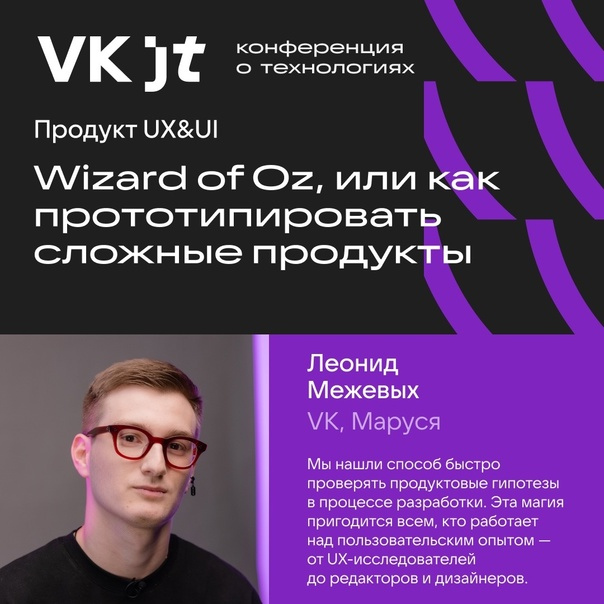

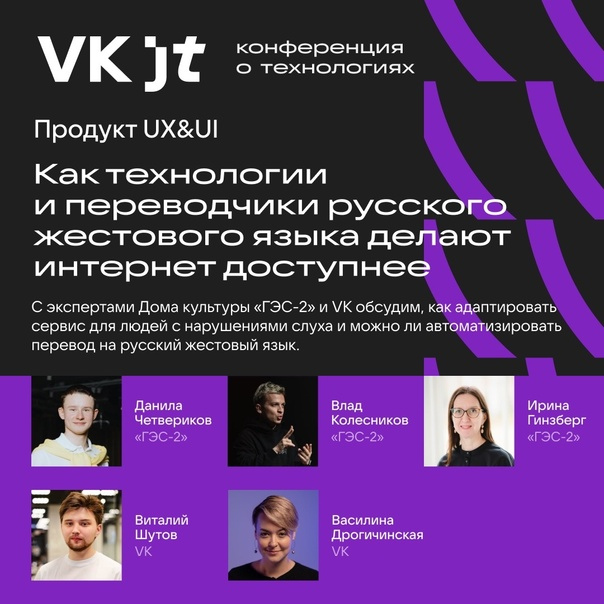

Дизайн — больше чем красиво ✨

На конференции VK JT мы поделимся нашим взглядом на дизайн, расскажем о его пользе и возможностях. А пока ловите подборку интересных материалов по дизайну цифровых продуктов:

• Синхронизируем дизайн и код: vk.cc/cv54Vk;

• Слияние дизайн-систем: vk.cc/cv54Wq;

• Доступность в изображениях: vk.cc/cv54Y8;

• Дизайн-процессы в Mail.ru: vk.cc/csdiYD;

• Красота дизайна для бизнеса: vk.cc/cv550r.

Встречаемся 6 марта на VK JT ?

Регистрация и расписание: vkjt.ru.

Следим за безопасностью ?

Каждый день мы делаем всё, чтобы обезопасить сервисы, проекты и людей, которые ими пользуются. В преддверии VK JT собрали подборку материалов по теме безопасности, самое интересное за последний год:

• Защищаем базы данных от взлома, ориентируясь на свои возможности: vk.cc/cv1ae4;

• Приватные облака в VK: виртуализация и безопасная разработка: vk.cc/cv1aiz;

• Будущее беспарольной аутентификации: vk.cc/cv1alI;

• Несложный и безопасный вывод трафика из изолированных сетей: vk.cc/cv1anL;

• Работа с Kubernetes: уязвимости и как себя обезопасить: vk.cc/cr1wrw.

До встречи на конференции VK JT 6 марта!

Подробнее — vkjt.ru.